配信でアバター(FaceRig)に棒読みちゃん(コメント)を口パクしてもらう!

たぶん、FaceRig以外にも応用が利くのではないかと思います。

FaceRig Virtual Audioを使ってみる

棒読みちゃんでは音声出力デバイスを選択できます。これを利用してFaceRigに棒読みちゃんの音声を流してFaceRigのアバターに棒読みちゃんの音声を口パクさせてみましょう。

棒読みちゃんの設定の「音声出力デバイス」に「FaceRig Virtual・・・」を選択します。

FaceRigの設定で「オーディオ録音デバイス」に「FaceRig Virtual・・・」を選択します。

「オーディオベースのリップシンクに切り替え」を有効にします。サウンドの設定でサウンドループバックを有効にします。

以上で完了です。

自動瞬きさせる

少し寂しいので自動瞬きも設定してはいかがでしょうか。

トラブル1:起動するたびに「更新する」ボタンを押す必要がある!

これ、たぶんバグ?です。

私の環境では起動するたびにデバイスの「更新する」ボタンを押さないと変なデバイスに接続されます。

これはお手上げでした。同じ現象に出くわした方は毎起動時に「更新する」ボタンを押してください・・・

トラブル2:棒読みちゃんにノイズが入る!

これも、たぶんバグ?です。 私の環境では、この方法では読み上げにノイズが入り使い物になりませんでした・・・ 従って違う仮想オーディオデバイスを使うことで解決としました。

別の仮想オーディオデバイスを導入する

Yamaha Syncroomというアプリケーションに入っている仮想オーディオデバイスを拝借します。

SYNCROOM(シンクルーム)- 音で繋がるオンライン演奏アプリ

元々は、離れた場所にいる人たちがリアルタイムに音楽演奏できるようにするアプリケーションです。

棒読みちゃんの設定の「音声出力デバイス」に「Yamaha SYNCROOM・・・」を選択します。

FaceRigの設定でオーディオ録音デバイスを「Yamaha SYNCROOM・・・」に変更します。

以上でトラブル2は解決できました!

サンプル:

youtu.be

配信や動画で FaceRig を使って Linve2D モデルを動かす!

※今更ですが、今年2021年で販売終了してしまうかもしれないFaceRigについての備忘録を書きます。AnimazeというFaceRigの後継ソフトが公開されています。しかしながら、FaceRig は買い切りなのに対して、Animazeはサブスクリプション制(無料版もあるらしい)となっています。もしかすると、今のうちにFaceRigを買っておくというのも手かもしれません。なお、すでにFaceRigを所有している場合は、Animazeのサブスクリプションが自動的に割引されるとのことです。

(有料)FaceRigとFaceRig Live2D Moduleをインストールする

まずはSteamでFaceRigを手に入れます。SteamでFaceRigと検索に入れて選択します。

少し下の方にスクロールして、通常価格は1480円です。セールで割引されます。

FaceRigでLive2Dモデルを使うには、追加でFaceRig Live2D Moduleが必要になります。さらに下の方にスクロールして「すべてを見る」をクリックすると表示されます。通常価格は398円です。こちらもセールで割引があります。

FaceRigとFaceRig Live2D ModuleをインストールしてFaceRigの準備は完了です。

Live2Dモデルを導入する

FaceRigのObjectsフォルダにLive2Dモデルのデータをコピーします。その際にFaceRig用のファイルが追加で必要になります。詳しい内容は他のサイトにお任せします。

デフォルトでは下記のフォルダになります。(FaceRigのインストール先により異なります)

C:\Program Files (x86)\Steam\steamapps\common\FaceRig\Mod\VP\PC_CustomData\Objects

Live2Dモデルは自作するか『nizima』や他のwebサイトから入手しましょう。FaceRig対応と書いてあるならFaceRig用のファイルも一式入っている・・・と思います。

『nizima』https://nizima.com/

準備ができたらFaceRigを起動します。

Live2Dモデルの作り方は余裕があったら別の記事で書こうと思います。

FaceRigを起動する

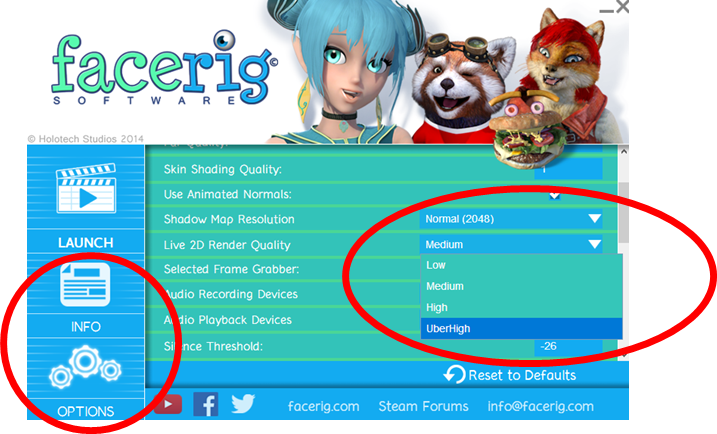

このような画面が表示されます。Options(オプション)を選択して、下にスクロールするとLive2D Render Qualityがあります。パソコンの性能と相談して調整ですが、UberHighをお勧めします。

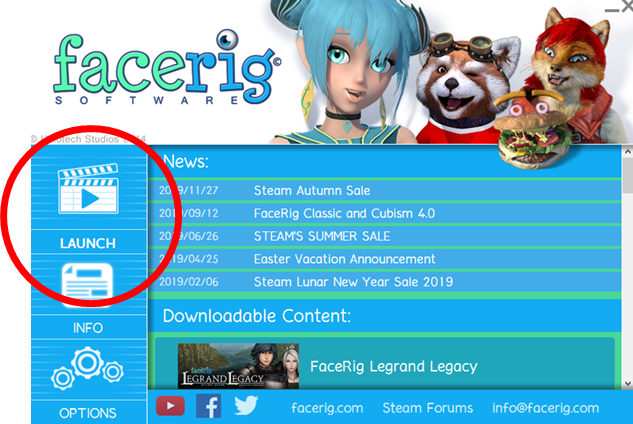

LAUNCHを押して、モデルの表示画面を起動します。起動に時間が少しかかるので、連打しないでしばらく待ちましょう

初期値では左下にカメラのプレビューが表示されます。プレビューで顔を認識しているか確認してください。顔を認識しているとモデルが動きます。

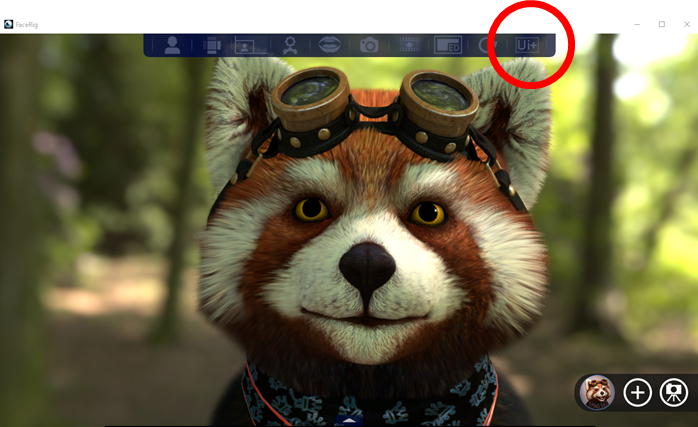

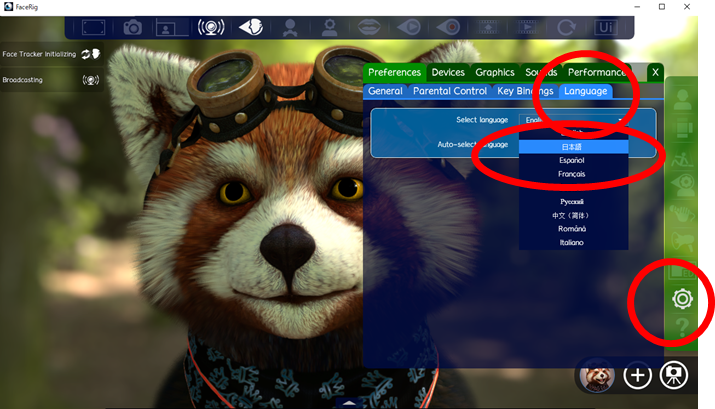

表示を日本語に変更しましょう。上のメニューの一番右にあるアドバンスUIをクリックします。

右に追加されたメニューの設定で言語を日本語にします。

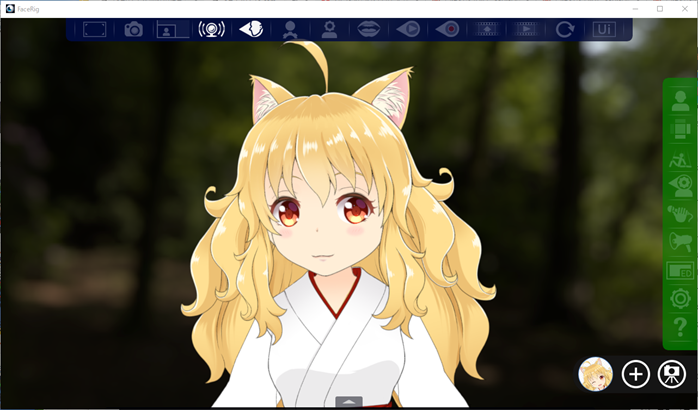

Live2Dモデルを表示する

アバターを選択して、Live2Dモデルに変更します。Live2Dモデルは下の方にスクロールするとあります。

Live2Dモデルが表示されます。でも、相性などで思ったように表情が出せないことが多いです。特に目や口の開き方が気になると思います。

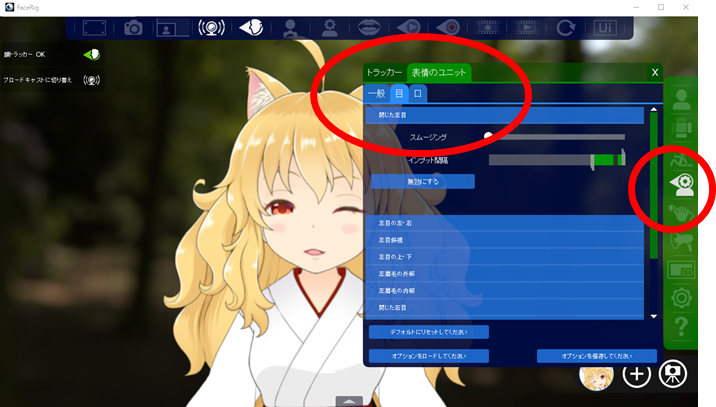

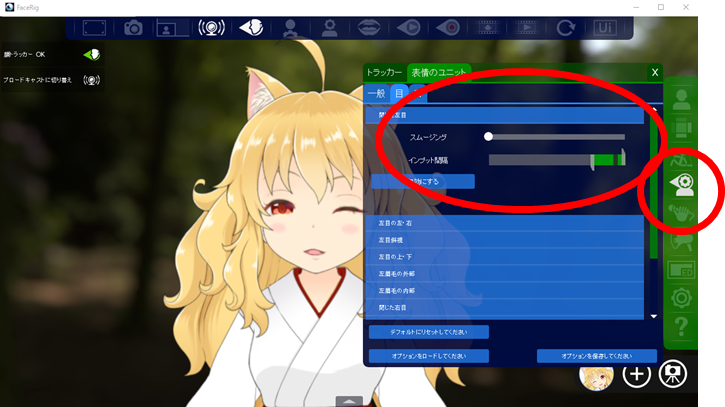

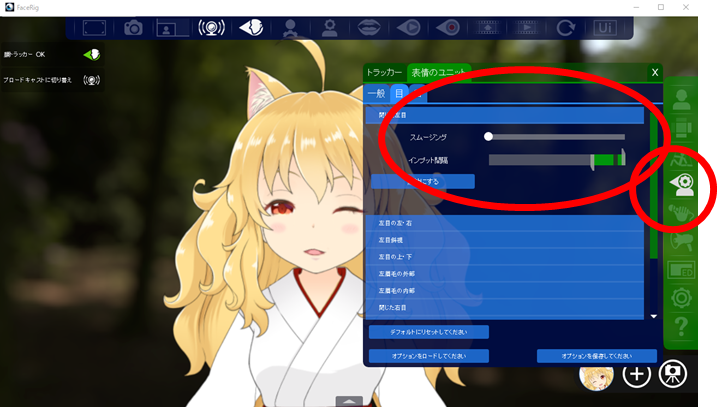

「高度なトラッキング」の設定を使って調整します。面倒ですが、これをしないとだいぶ動きに差が出ます。表情のユニットを調整します。(モデルにより大きく異なります)

インプット感覚は最低値・最高値に合わせて目盛りを調整します。目を閉じたとき、通常のとき、で黒い線が動くので、そこに合わせて目盛りを合わせます。

スムージングは下げると応答が速くなりますが、部位によってはカクカクが目立つので調整してください。私は口と目の開閉は0にします。

調整がうまくできると、なかなかよく動いてくれます。

配信ソフト(OBS Studio)の設定例

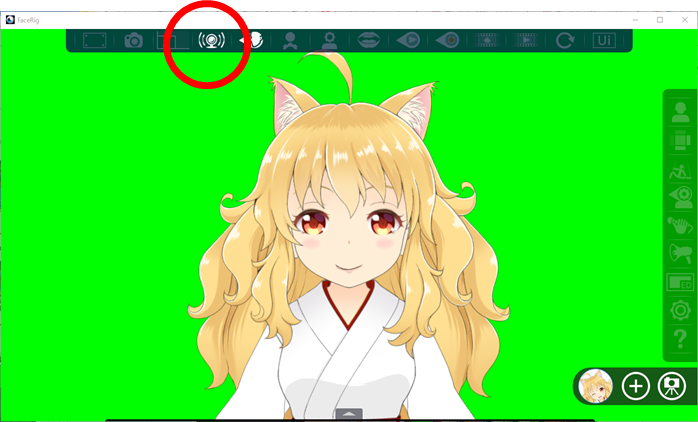

続いて配信に使う方法を説明します。例として配信ソフトのOBS Studioを使用します。配信では背景が不要なので、クロマキーという機能を使って背景を消します。まず、環境から背景を緑にします。

緑にしたらブロードキャストを選択します。これによって「FaceRig Virtual Camera」という仮想カメラに映像が出力されます。

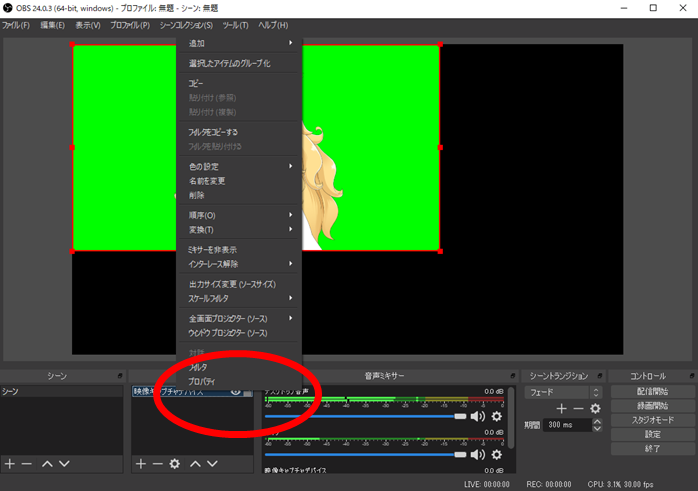

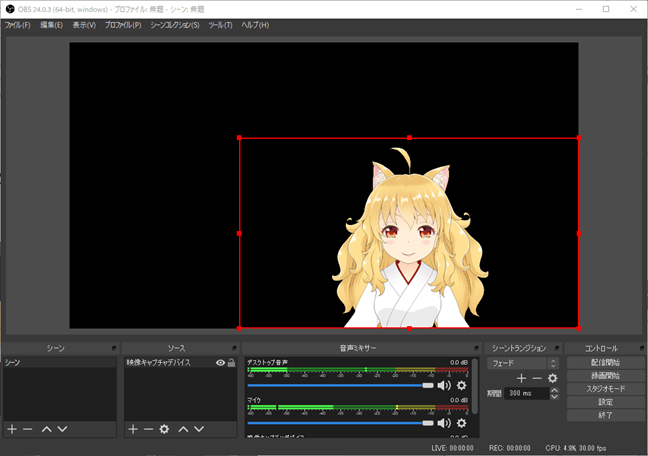

では、配信ソフトのOBS Studioでクロマキーを設定してみます。OBSを起動して、ソースの追加で「映像キャプチャデバイス」を選択します。

デバイスに「FaceRig Virtual Camera」を選択します。そうすると、こんな感じにFaceRigの画面が表示されます。

「映像キャプチャデバイス」を右クリックしてフィルタをクリックします。

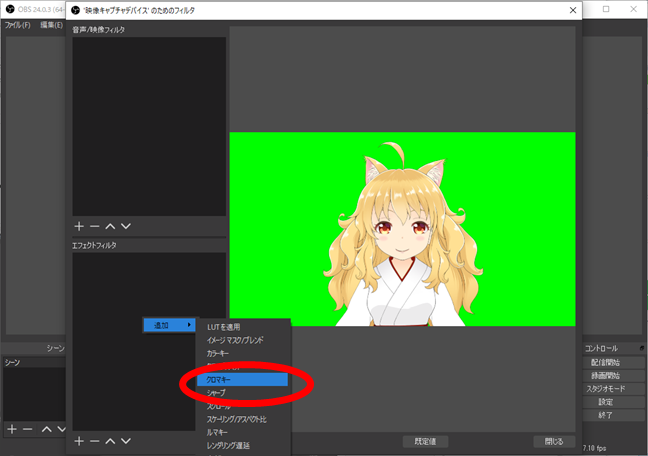

エフェクトフィルタの中で右クリックして、追加を選択して、クロマキーを追加します。

そうすると、緑の背景が透明になります。(モデルに緑に近い色があると一緒に透明になってしまうので、その場合は設定値を調整してください)

メイン画面で好きな場所に配置します。

あとは、ソースにウィンドウキャプチャなどで、放送したい画面を追加すれば完成です。Live2Dモデルを使って、楽しい放送を作り上げましょう。

最後まで見てくださりありがとうございました。

私のモデルも『nizima』サイトに投稿してたりします。

(イラスト画:ソレさん@_solesolesole)

https://nizima.com/item/detailitem/24636

モデルプレビュー動画:

youtu.be